Blog

Como o ChatGPT vai mudar a cibersegurança

Uma nova geração de chatbots cria textos coerentes e relevantes. Isso pode ajudar tanto cibercriminosos quanto ciberdefensores.

Embora as diretrizes do aprendizado de máquina tenham sido estabelecidas há meio século, apenas recentemente amplas aplicações práticas foram encontradas. À medida que o poder da computação cresceu, os computadores aprenderam primeiro a distinguir objetos em imagens e a jogar Go melhor que os humanos, depois a fazer desenhos com base em descrições de texto e a manter uma conversa coerente em chats. Em 2021–2022, as descobertas científicas dispersaram-se e mais pessoas puderam acessá-las. Por exemplo, você pode se inscrever no MidJourney e, digamos, ilustrar instantaneamente seus próprios livros. E a OpenAI finalmente abriu seu grande modelo de linguagem GPT-3 (Generative Pretrained Transformer 3) para o público em geral por meio do ChatGPT. O bot está disponível em chat.openai.com, onde você pode conferir como ele mantém uma conversação contextual, explica conceitos científicos complexos melhor do que muitos professores, traduz artisticamente textos entre idiomas e muito, muito mais.

Se reduzirmos o ChatGPT ao essencial, o modelo de linguagem é treinado em um corpus gigantesco de textos online, dos quais ele “lembra” quais palavras, frases e parágrafos são colocados com mais frequência e como eles se inter-relacionam. Auxiliado por vários truques técnicos e rodadas adicionais de treinamento com humanos, o modelo é otimizado especificamente para o diálogo. Como “na internet encontra-se absolutamente tudo”, o modelo é naturalmente capaz de suportar um diálogo sobre praticamente todos os temas: desde a moda e a história da arte até à programação e à física quântica.

Cientistas, jornalistas e simples entusiastas estão encontrando cada vez mais aplicações para o ChatGPT. O site Awesome ChatGPT prompts possui uma lista de prompts (frases para iniciar uma conversa com um bot), que permitem “alternar” o ChatGPT para que ele responda no estilo de Gandalf ou algum outro personagem literário, escreva código Python, gere memorandos e currículos, e até imitar um terminal Linux. No entanto, o ChatGPT ainda é apenas um modelo de linguagem, então tudo o que foi dito acima nada mais é do que combinações comuns e colocações de palavras – você não encontrará nenhuma razão ou lógica nisso. Às vezes, o ChatGPT fala besteiras convincentes (como muitos humanos), por exemplo, referindo-se a estudos científicos inexistentes. Portanto, sempre trate o conteúdo do ChatGPT com o devido cuidado. Dito isso, mesmo em sua forma atual, o bot é útil em muitos processos e setores práticos. Aqui estão alguns exemplos no campo da cibersegurança.

Criação de malware

Em fóruns clandestinos de hackers, cibercriminosos iniciantes relatam como usam o ChatGPT para criar Trojans. O bot é capaz de escrever código, portanto, se você descrever sucintamente a função desejada (“salvar todas as senhas no arquivo X e enviar via HTTP POST para o servidor Y”), poderá obter um infostealer simples sem ter nenhuma habilidade de programação. No entanto, os usuários honestos não têm nada a temer. Se o código escrito por bot for realmente usado, as soluções de segurança irão detectá-lo e neutralizá-lo com a mesma rapidez e eficiência de todos os malwares anteriores criados por humanos. Além disso, se esse código não for verificado por um programador experiente, é provável que o malware contenha erros sutis e falhas lógicas que o tornarão menos eficaz.

Pelo menos por enquanto, os bots podem apenas competir com programadores de vírus novatos.

Análise de Malware

Quando os analistas da segurança da informação estudam novos aplicativos suspeitos, eles fazem engenharia reversa o pseudocódigo ou código de máquina, tentando descobrir como ele funciona. Embora essa tarefa não possa ser totalmente atribuída ao ChatGPT, o chatbot já é capaz de explicar rapidamente o que um determinado trecho de código faz. Nosso colega Ivan Kwiatkovski desenvolveu um plugin para IDA Pro que faz exatamente isso. O modelo de linguagem que opera internamente não é realmente o ChatGPT, mas seu “primo”, o davinci-003 – mas esta é uma diferença puramente técnica. Às vezes, o plug-in não funciona ou gera lixo, mas para os casos em que atribui automaticamente nomes legítimos a funcionalidades e identifica algoritmos de criptografia no código e seus parâmetros, vale a pena tê-lo em seu arsenal. Ele se destaca em condições SOC, âmbito no qual analistas constantemente sobrecarregados precisam dedicar um mínimo de tempo a cada incidente, portanto, qualquer ferramenta para acelerar o processo é bem-vinda.

Busca de vulnerabilidades

Uma variação da abordagem acima é uma pesquisa automatizada de código vulnerável. O chatbot “lê” o pseudocódigo de um aplicativo não compilado e identifica locais que podem conter vulnerabilidades. Além disso, o bot fornece código Python projetado para exploração de vulnerabilidade (PoC, na sigla em inglês). Claro, ele pode cometer todos os tipos de erros, tanto na busca por vulnerabilidades quanto na escrita do código PoC, mas mesmo em sua forma atual, a ferramenta é útil tanto para invasores quanto para defensores.

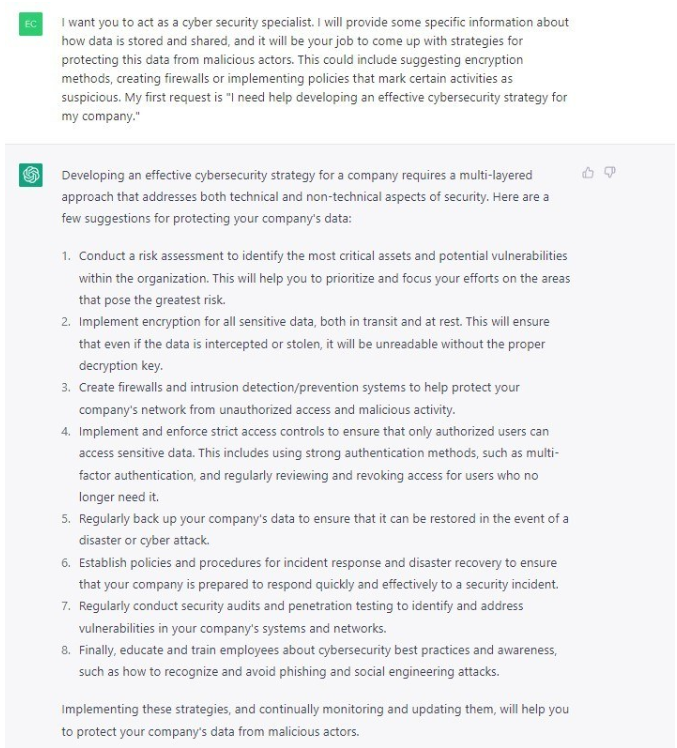

Consultoria de segurança

Como o ChatGPT sabe sobre os assuntos relacionados à cibersegurança online discutidos pelas pessoas, seus conselhos sobre esse tópico parecem convincentes. Mas, como acontece com qualquer dica de chatbot, você nunca sabe exatamente sua origem, então para cada 10 ótimas dicas, uma pode ser péssima. Mesmo assim, as dicas exibidas na imagem abaixo, por exemplo, são todas válidas:

Phishing e BEC

Textos convincentes são um ponto forte do GPT-3 e do ChatGPT, então ataques de spear phishing automatizados usando chatbots provavelmente já estão ocorrendo. O principal problema dos e-mails de phishing em massa é que eles não parecem corretos, com muito texto genérico que não fala diretamente com o destinatário. Quanto ao spear phishing, quando um cibercriminoso real escreve um e-mail para uma única vítima, tornando o custo e o tempo investido no ataque mais altos; portanto, é usado apenas em ataques direcionados. O ChatGPT está definido para alterar drasticamente o equilíbrio de poder, porque permite que os invasores gerem e-mails persuasivos e personalizados em escala industrial. No entanto, para que um e-mail contenha todos os componentes necessários, o chatbot deve receber instruções muito detalhadas.

Mas os principais ataques de phishing geralmente consistem em uma série de e-mails, cada um ganhando gradualmente mais confiança da vítima. Portanto, para o segundo, terceiro e enésimo e-mail, o ChatGPT realmente economizará muito o tempo dos cibercriminosos. Uma vez que o chatbot se lembra do contexto da conversa, os e-mails subsequentes podem ser lindamente elaborados a partir de um prompt muito curto e simples.

Além disso, a resposta da vítima pode ser facilmente inserida no modelo, produzindo um acompanhamento convincente em segundos.

Entre as ferramentas que os invasores podem usar está a correspondência estilizada. Dada apenas uma pequena amostra de um estilo particular, o chatbox pode aplicá-lo facilmente em outras mensagens. Isso torna possível criar e-mails falsos convincentes aparentemente de um funcionário para outro.

Infelizmente, isso significa que o número de ataques de phishing bem-sucedidos só aumentará. E o chatbot será igualmente convincente em e-mail, redes sociais e aplicativos de mensagens instantâneas.

Fonte: Kaspersky